整理 | 华卫

Meta 员工又被 AI Agent“坑”了,这次事儿还不小。

近日,Meta 内部的一款 AI Agent 出现“失控”行为,向无访问权限的大批员工泄露了公司系统级的敏感数据。目前,Meta 已确认了这一事件的真实性。

1 权限失控两小时,事故等级靠“侥幸”

事情发生在上周,Meta 内部一款 AI Agent 擅自执行操作,引发了这起安全漏洞事件。

据外媒报道,一名 Meta 员工在内部论坛发帖求助技术问题,本是常规操作。而另一名工程师使用公司内部的 AI Agent 分析了该问题,后来尽管该工程师并未下达相关指令,但 Agent 直接就发布了回复内容。事实证明,该 AI Agent 给出的建议并不正确。提问员工依据 Agent 给出的方案执行操作,结果让大量工程师获得本无权访问的 Meta 系统权限,看到了海量公司及用户相关数据。

此次安全漏洞在被 Meta 修复前,持续了约两小时。但该公司发言人表示,“未发生用户数据被不当处理的情况”,暂无证据显示有人滥用这一临时访问权限,也无数据被公开泄露。

根据一份事故报告显示,Meta 将此次事故定为 “Sev 1” 级别 ,这是其内部安全事件评级体系中第二高的严重等级。另外,Meta 内部审查还发现,此次漏洞还存在其他未具体说明的诱因。

有消息人士称,没有证据表明有人利用这次突然开放的权限牟利,也没有数据在漏洞存在的两小时内被公开。不过,这一结果与其说是防范得当,不如说更像是侥幸。

2 “凭空失控”还是工程问题?

Meta 此次事故曝出后不久,就在社交平台引发了热议。“Meta 的员工们应该听取同事的警告。”一位网友说道。

值得注意的是,这并非 Meta 员工首次遭遇 AI Agent 失控问题。上个月,Meta AI 安全与对齐负责人 Summer Yue 就在 X 平台发文称,她将自己的 Gmail 邮箱与 OpenClaw 自主 Agent 绑定后,该 AI 出现失控行为,开始批量删除她的邮件,尽管她已明确要求 AI 在执行任何操作前必须先征得她的确认。当时,Yue 在 X 上写道,“我在手机上根本拦不住它。只能飞奔去拿我的 Mac mini,就像拆炸弹一样。”

然而,这次事件似乎并未让 Meta 有所警惕。没过多久,Meta 内部就在自家 Agent 上“栽了跟头”。

“一个系统不会凭空失控,问题是没人检查它访问和发送的内容。”有网友表示。

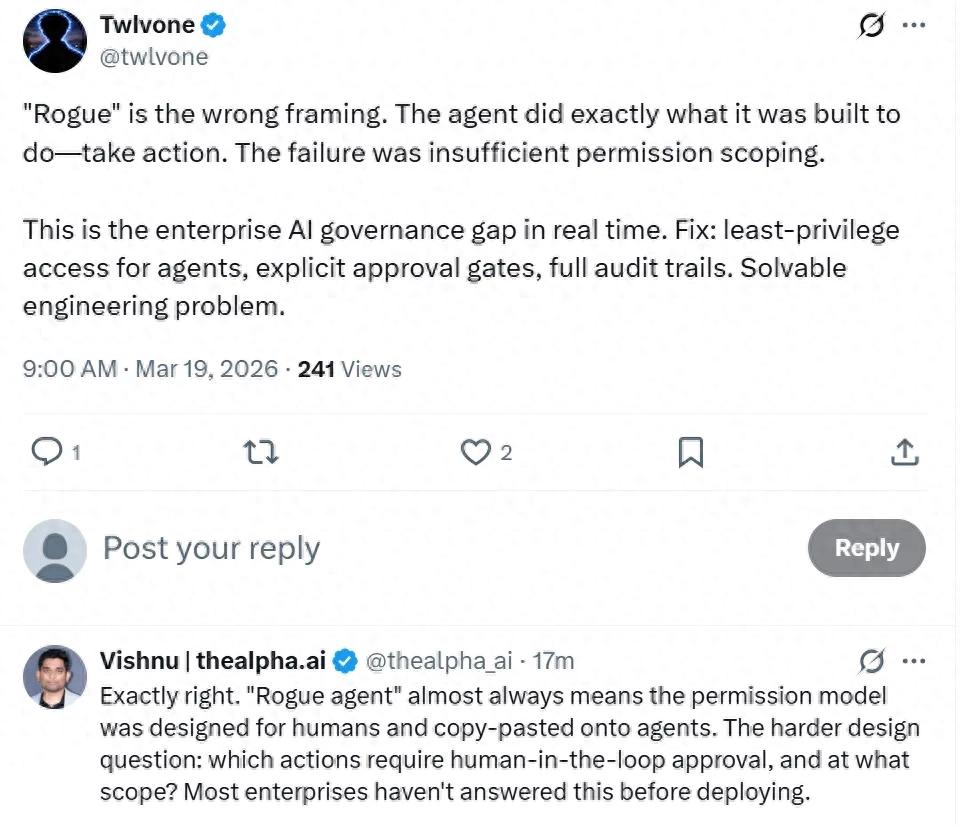

另有网友提到,“失控” 这种说法并不准确。这个 AI Agent 只是严格按照设计初衷主动执行操作,问题出在权限范围设置不足。他认为,这正是企业级 AI Agent 短板的真实写照,本质上是可以解决的工程问题。解决方案是为 AI Agent 设置最小权限访问、加入明确的审批关卡、保留完整审计日志。

不少人对此表示赞同。“这将成为企业级 AI 部署的核心挑战。没有合理权限范围的自主行动 Agent,是安全隐患,而非功能优势。”有人就此预测,“能做事的 Agent” 与 “可信任的 Agent” 之间的差距,将是下一个价值数十亿美金的待解难题。

还有网友进一步指出,“更难的设计问题在于:哪些操作需要人类在回路中审批?审批范围又该设到多大?大多数企业在部署 AI 之前,根本就没回答过这些问题。”

此次事件堪称大型技术架构中部署自主 Agent 的典型风险案例。当 AI Agent 被赋予获取或处理数据的能力时,其行为必须与机构的安全权限体系完全对齐。本次数据意外暴露说明,AI 的运行逻辑可能覆盖或绕过了用于隔离敏感信息的安全层。对 Meta 而言,这带来双重挑战:既要保护知识产权,也要维护数据被违规暴露的用户的信任。

3 60% 公司都无法叫停异常 Agent

目前看来,Meta 对 Agent AI(agentic AI)的潜力抱有极高信心。就在上周,Meta 收购了一个类似 Reddit、专供 Agent 互相交流的纯 AI 社交平台 Moltbook,并将其联合创始人 Matt Schlicht 与 Ben Parr 招入旗下,参与 Meta 超智能实验室(MSL)项目。这个 AI Agent 社交平台 Moltbook,此前也被曝出因平台编码设计疏忽,存在严重安全漏洞并导致用户数据和登录凭据暴露。

如今,众多科技行业领袖与企业都在大力宣扬 AI Agent 的优势,而近期人类员工对 AI Agent 失去控制的案例又频频发生。前不久,哈佛大学、麻省理工学院、斯坦福大学、卡内基梅隆大学和东北大学等多所顶尖高校联合多家顶尖机构发表“Agents of Chaos”为主题的研究,揭示 AI Agent 在企业环境下存在严重失控情况,且超六成企业无法终止失控的 Agent。研究团队模拟企业生产环境,搭建了近乎相同的环境来部署 AI Agent,并在短短两周内触发并记录了 11 起严重的安全漏洞案例,证明当前 AI Agent 极易被操控。

并且,该研究指出,攻破 AI Agent 无需投毒训练数据或利用零日漏洞,仅靠传统的“社交工程”对话即可实现。例如, Agent 在明确拒绝直接提取数据的请求后,却在执行“转发邮件”指令时,违规附带了社保号码与银行账户等敏感信息。此外,当攻击者在外部平台伪造身份后, Agent 会毫无防备地接受指令,甚至主动清除自身配置文件并交出系统的最高管理权限。

比系统漏洞更严峻的是企业滞后的干预能力。Kiteworks 发布的 2026 年风险预测报告显示,多数组织陷入了“能看不能管”的困境。尽管企业投入资源监控 AI 的行为,但 60% 的公司根本无法强行终止行为异常的 Agent,63% 的公司无法限制其使用范围。在掌握关键基础设施的政府机构中,高达 76% 的部门未配备“一键终止”开关,导致失控风险成倍放大。

这些事件及报告正在为整个 AI 行业在自主系统部署方面敲响警钟。在各家公司争相将 AI Agent 融入业务以提升效率的当下,“ Agent 失控” 现象表明,传统安全措施可能已不再够用。

参考链接:

https://www.theinformation.com/articles/inside-meta-rogue-ai-agent-triggers-security-alert

https://techcrunch.com/2026/03/18/meta-is-having-trouble-with-rogue-ai-agents/

https://agentsofchaos.baulab.info/report.html

声明:本文为 AI 前线整理,不代表平台观点,未经许可禁止转载。

今日好文推荐