这项由北京科技大学与北京通用人工智能研究院联合完成的研究,于2026年4月以预印本形式发布在arXiv平台,编号为arXiv:2604.16593v1,完整论文已开源,感兴趣的读者可通过该编号检索全文。

人类语言有一种奇妙的特性:说出来的话,往往不是字面上的意思。"他在走钢丝",并不是真的说这个人在钢索上行走;"这不是火箭科学",也不是在谈航天工程。这种"话中有话"的表达方式在日常生活中无处不在,却一直是人工智能理解语言时最棘手的障碍之一。研究团队正是瞄准了这一痛点,构建了一个名为SEMANTICQA的测试平台,专门用来测量各类语言模型在处理这类"非字面表达"时的真实水平。

这件事之所以值得关注,是因为我们正越来越多地依赖AI助手来阅读文件、翻译文本、分析情绪,而这些助手是否真的"读懂"了语言,还是只是在走字面意思的捷径,直接关系到它们给出的答案是否可信。就好像雇了一位翻译,表面上他能把每个字都换成另一种语言,但如果他不懂"打退堂鼓"是什么意思,翻译出来的内容就会南辕北辙。

---

一、语言的"暗语"系统:为什么AI理解成语那么难

人类从小就学会了语言里的"潜台词"。当老师说"这道题不是什么难事",学生知道他在鼓励;当朋友说"你真是个好人",语气不同时可能含义截然相反。这种依靠约定俗成、依靠文化背景、依靠上下文才能解读的表达,语言学家给了它们一个统一的名字——多词表达(Multiword Expressions,简称MWE),也可以叫做"语义短语"。

研究团队将这类表达分成四大家族。第一类是惯用语(Idiomatic Expressions),也就是中文里的成语、歇后语,英语里的"kick the bucket"(踢桶子,意思是死亡)之类,整个短语的意思完全无法从单个词推导出来。第二类是词汇搭配(Lexical Collocations),指那些固定搭配在一起的词组,比如"heavy rain"(大雨)而不是"big rain",这类表达在字面上说得通,但语感上只有特定搭配才自然。第三类是名词复合词(Noun Compounds),比如"baby oil"(婴儿润肤油)和"olive oil"(橄榄油),同样是"XX oil",但前者并不是用婴儿榨出来的油,后者才是真的从橄榄里压出来的——理解这种差别需要世界知识和语境推断。第四类是动词性多词表达(Verbal Constructions),包括"take place"(发生)、"give up"(放弃)这类轻动词结构,以及"click on"(点击)这类动词加小词的组合,意思往往是半透明的,字面和引申义之间存在微妙关联。

这四大家族构成了SEMANTICQA的测试对象。每一类都像是一道不同难度的密码,需要语言模型在读懂"明文"之外,还要破译隐藏在字面之下的真实含义。

---

二、考场搭建:三种不同的考题类型

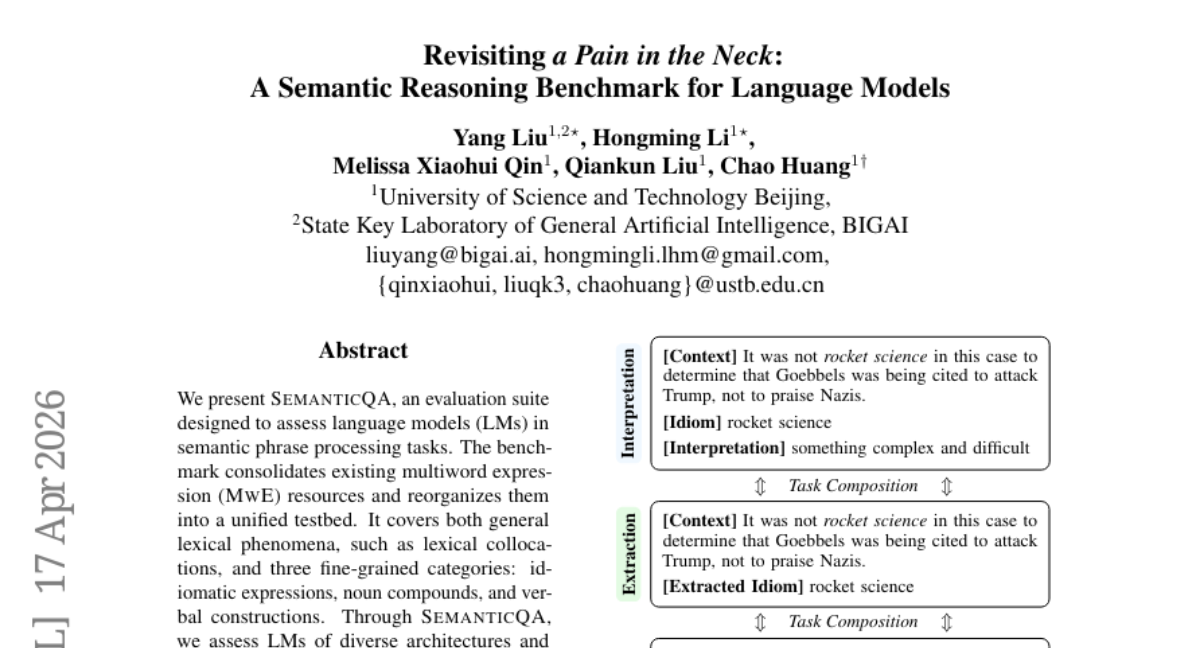

北京科技大学的团队没有只出一种题,而是为每类语义短语设计了三种不同形式的考题,分别考察"认出它"、"找到它"和"解释它"三种能力——对应的是分类(Classification)、抽取(Extraction)和解释(Interpretation)三类任务。

分类任务相当于做选择题。给模型一个包含"rocket science"的句子,再给出四个选项,让它选择这个短语在这里是什么意思:A选项是"导弹知识",B选项是"困难的事",C选项是"专有名词",D选项是"字面用法"。这考察的是模型能否在多个候选答案中识别出正确的语义。

抽取任务则像是在文章里划重点。给模型一段话,让它直接找出并标注出其中的惯用语或搭配词。这要求模型既要理解什么算是"特殊表达",还要精确定位它在句子里的位置,不能多标也不能少标。

解释任务是三者中最开放的,也最接近人类的实际理解过程。给模型一句话和其中的一个短语,让它用自己的话解释这个短语在这里是什么意思,就像字典里的释义一样。这不是选择题,也不是找答案,而是要求模型生成一段文字来表达它的理解。

三种考题覆盖了从"认识"到"理解"再到"表达"的完整理解链条。研究团队的核心洞察在于:一个真正理解语义的模型,应该在这三种形式的考题上都表现出一致的水准——如果一个模型能解释"kick the bucket"的意思,理论上它也应该能在选择题里选对,也能在句子里找到它。反之,如果三种题目的得分差异很大,就说明模型可能只是在"猜对了答案",而并非真的读懂了语言。

---

三、题库来源:从多个数据库拼出一张完整的语义地图

建这个考场不是从零开始的。研究团队从多个已有的学术数据资源中精心挑选和整合,形成了一套统一格式的测试集。具体来说,惯用语的检测题来自Harish等人在2021年发布的数据集,共273道题;惯用语的抽取题来自Tedeschi等人2022年针对十种语言的惯用语识别数据集,取其中447个含有惯用语的英语样本;惯用语的解释题则综合了Zhou等人2021年的PIE语料库和Chakrabarty等人2022年关于叙事语言中比喻表达的研究,最终汇集818个样本。

词汇搭配部分,分类题和解释题都来源于Espinosa-Anke等人2021年的LEXFUNC扩展数据集,各取305个样本;抽取题则来自Fisas等人2020年的双语搭配资源。名词复合词部分,合成性分类题来自Garcia等人2021年关于词向量模型中惯用性表征评估的数据集,抽取题整合了Garcia和Kolluru两个团队的资源,共720个样本,解释题则来自Coil和Shwartz 2023年的研究,取110个样本。动词性多词表达的抽取题来自PARSEME语料库的1.3版本,这是目前最大规模的动词多词表达标注语料,共475个样本。

这些数据来源各异,标注标准不统一,难度分布也不相同。研究团队特别强调,他们的目标不是让不同类型的短语之间可以直接横向比较,而是在同一类型的不同考题之间观察模型的表现规律。好比不能直接比较"数学题做对多少道"和"作文写了多少字",但可以比较"同一个学生在数学的填空题、选择题和解答题上分别表现如何"。

---

四、考试现场:从小模型到最强大模型一一上阵

研究团队邀请了一批来自不同"门派"的语言模型参加这场测试。参与者包括OpenAI的GPT-5、GPT-4、GPT-3.5-Turbo和o3,Anthropic的Claude-Sonnet-4.5、Claude-3-Opus和Claude-Instant-1,Google的Gemini-2.5-Pro和Gemini-1.0-Pro,以及开源阵营的DeepSeek-R1、Qwen3-235B(参数量高达2350亿)、Kimi-K2-Instruct(参数量达1万亿)和Gemma-3-27B-it。此外,还有两个经过专门微调的小型模型BERT-base和BERT-large,以及用于文本生成任务的T5-base和T5-large。

为了对比参考,研究团队还邀请了三位语言学专业的研究生参与测试,每人在每道题上随机标注了100个样本,以此估算人类的表现水平作为参照基准。

每道题的评分方式根据题型各有不同。选择题直接看选对了没有,计算准确率。抽取题要求完全精确匹配,不能多一个字也不能少一个字,这是为了避免"部分答对也算分"带来的虚高分数。解释题则用了三种不同的打分方式:METEOR分数主要衡量词汇重叠和同义词覆盖,ROUGE-L分数衡量最长公共子序列的匹配程度,BERTScore则用语义向量的相似度来衡量意思是否对应,三个维度互补,共同评估解释质量。

---

五、成绩揭晓:没有全科满分的"学霸"

考试结果颇具戏剧性——没有任何一个模型在所有题型和所有短语类型上都表现出色。这个结论本身就很有意思:如果一个模型真的"读懂"了语言,它应该在考察同一个知识点的不同题型上都表现稳定。但实际情况是,每个模型都有自己的强项和弱点,而且这些强弱点往往与题型密切相关,而不是与短语类型相关。

以GPT-5为例,在惯用语的检测(选择题)上,零样本情况下得分82.8%,五样本情况下提升到85.4%,已经超过了人类基准71%的水平。但在惯用语的抽取(精确定位)任务上,GPT-5的零样本得分只有67.6%,而人类的参照基准则高达87%。换句话说,这个模型在"知道答案是什么"和"知道答案在哪里"之间存在明显落差,就像一个学生能回答"成语是什么意思",却未必能在一篇文章里准确圈出哪个短语是成语。

在词汇搭配的分类任务上,DeepSeek-R1表现亮眼,五样本情况下达到76.1%,OpenAI o3三样本时更是达到85.9%,GPT-5三样本时也达到86.2%。但在词汇搭配的抽取任务上,各模型的得分普遍低于人类基准50%,大多数模型在30%到70%区间波动,表明精确定位搭配词对所有模型都是难题。

解释任务是最特殊的一道题。由于答案是开放式生成的,BERTScore的得分往往较高(多数模型在85%到92%区间),但METEOR分数和ROUGE-L分数却相对偏低,特别是惯用语解释任务的METEOR分数,多数模型不超过30%,而人类参照基准也只有20.5%。这种"BERTScore高,METEOR低"的现象说明什么?它说明模型的解释在语义方向上是对的,但用词和表达方式与标准答案差异较大——模型换了一种说法,意思没错,但和参考答案的具体措辞对不上。

---

六、"参考例题"的魔力:给几个例子会有多大帮助

研究团队对零样本(不给任何例子)、三样本(给三个例题)和五样本(给五个例题)三种不同情况进行了系统比较。这种做法在AI领域叫做"上下文学习"(In-Context Learning),简单理解就是:考试前让模型先看几道例题,看看能不能帮助它更好地答题。

结论是,例题对不同类型的考题帮助效果差异显著。解释任务受益最稳定:给三到五个例子之后,几乎所有模型的METEOR分数都明显上升。比如DeepSeek-R1在惯用语解释任务上,零样本得12.4分,三样本提升到19.4分,五样本维持在19.2分。但细看BERTScore,这些提升主要体现在答案的表达形式更贴近例题风格,而不一定代表模型理解得更深——就好比学生看了几道例题,学会了答题的"套路",但不代表真的弄懂了知识点。

分类任务的例题效果则是"看人下菜碟"的。原本零样本表现较差的模型,加入例题后往往有明显提升;而原本已经表现不错的模型,加入例题有时反而出现轻微下滑,或者停滞不前。这种现象在OpenAI o3处理词汇搭配分类题时尤为明显,暗示了例题质量、例题选择方式对结果的影响不可忽视。

抽取任务是最不稳定的一类。有时候给了例题之后成绩显著提升,因为例题展示了"你需要找出的是什么样的片段";但有时候,当测试题和例题的句子结构差异较大时,例题反而起到了误导作用,让模型往错误的方向去找。这说明对于精确定位任务,例题的示范效果高度依赖于例题与测试题之间的相似程度。

---

七、分类等级越多,越难分清:一场控制变量的"晋级考试"

研究团队专门针对词汇搭配的分类任务设计了一个有趣的压力测试:逐渐增加需要区分的类别数量,从1类一直到16类,观察模型的准确率如何变化。这16个类别对应的是语言学里"词汇功能"理论中的不同语义关系,包括表示"强烈程度"的Magn(比如"heavy rain"中的heavy),表示"真实性"的Ver(比如"clear message"中的clear),表示"积极评价"的Bon,以及表示发声动作的Son(比如"alarm clock rings"中的rings)等。

随着需要区分的类别从1个增加到16个,所有模型的准确率都出现了明显下滑,但下滑的速度因模型而异。以DeepSeek-R1为例,在零样本情况下,类别数为1时准确率是100%(因为只有一个选项),类别数增加到2时跌至81.7%,到8类时进一步降到49.3%,到16类时只剩35.4%。OpenAI o3和GPT-5表现相对更稳健,GPT-5在16类零样本情况下仍能维持56.3%,三样本时进一步提升到65.8%。

相比之下,经过专门微调训练的BERT-large模型在这项测试中表现出色,16类情况下仍能保持71.8%的准确率,下滑幅度远小于那些大型语言模型。这揭示了一个深层规律:当语义类别细分到一定程度,单靠"举一反三"的上下文学习能力是不够的,模型需要在训练过程中积累足够丰富的细粒度语义知识,才能在更复杂的分类场景中保持稳定。

---

八、连环闯关:当一道题的答案要依赖另一道题

研究团队还设计了一种更接近现实场景的"组合题"——要求模型先完成抽取任务,再用抽取出来的结果去完成分类或解释任务。这就像一场接力赛:第一棒选手(抽取模块)跑完之后,把接力棒交给第二棒(分类或解释模块),最终成绩取决于两棒选手的综合表现。

研究人员区分了两种计分方式:一种是"有条件得分"(Conditional),只统计第一棒跑对了的情况下,第二棒的得分;另一种是"整体得分"(Overall),直接看从头到尾的完整成功率。两者之间的差距,就反映了第一棒(抽取步骤)的准确率对最终结果的拖累程度。

结果显示,"有条件得分"始终高于"整体得分",有时差距相当悬殊。以词汇搭配的抽取-解释组合为例,GPT-5在五样本情况下,有条件METEOR得分是41.8%,但整体METEOR得分只有17.3%。这意味着:如果抽取步骤是准确的,解释做得还不错;但由于抽取本身的失误率较高,最终端到端的成功率被大幅压缩。增加例题(从零样本到三样本再到五样本)能帮助提升整体得分,但提升幅度相当有限,第一棒的失误率始终是整个流程的瓶颈。

惯用语的组合题情况更严峻。DeepSeek-R1在惯用语抽取-解释任务中,五样本情况下整体METEOR得分只有7.6%,而有条件得分也不过13.4%,说明即便抽取做对了,解释质量本身也还有提升空间。GPT-5略好一些,五样本整体得分10.1%,有条件得分17.1%,但依然与人类水平存在明显距离。

分类组合题呈现出另一种规律:类别数越多,分类的准确率下降越剧烈。GPT-5在词汇搭配的16类分类组合任务中,零样本整体得分33.1%,三样本提升到43.4%,五样本达到44.8%;而在4类分类任务中,整体得分分别是45.7%、58.1%和55.0%,差距相当明显。这说明,类别的精细程度是所有模型都面临的共同瓶颈。

---

九、给模型配备"工具书":一个简单策略带来的显著提升

在动词性多词表达的抽取任务中,研究团队测试了一种额外的辅助策略——在提示词(也就是给模型的"指令")里附上目标表达类型的定义和说明。比如,告诉模型"动词-小词结构(VPC)有时也叫短语动词,它的整体含义是完全或部分不可从字面推导的"。研究团队把这种策略称为"Oracle Schema"(可以理解为"附有说明书的考卷")。

对比结果相当直观。DeepSeek-R1在零样本情况下,不附说明时准确率51.6%,附上说明后提升到64.1%,整整高了12.5个百分点。三样本情况下,附说明的效果依然领先,从63.4%提升到72.3%。GPT-5的提升幅度也很可观:零样本从52.0%提升到59.6%,三样本从61.7%提升到66.8%,五样本从65.7%提升到72.6%。Kimi-K2-Instruct和OpenAI o3也都出现了稳定的正向提升。

这个发现背后的含义颇为深远:在缺乏充足训练数据的任务上,给模型提供清晰的语义定义和边界说明,能够有效弥补模型知识的不足。换句话说,"告诉模型我们在找什么",比"多给模型几个例子看",在某些场景下更加有效。

---

十、人类表现并非无懈可击:考题本身的模糊性

值得单独讨论的是人类参照基准的问题。三位语言学研究生在测试中的表现并不总是远超AI——在部分任务上,AI模型已经追平甚至超过了人类参照水平。比如在惯用语检测任务中,人类得分71%,而GPT-5五样本时达到85.4%。

但这并不意味着AI的理解能力真的超越了人类。研究团队解释说,人类标注分数较低的原因之一在于题目本身存在一定的模糊性,不同人对同一表达的理解可能存在合理分歧;此外,评分标准对人类和模型的影响方式并不完全对称,比如解释任务的METEOR分数对答案的措辞格式非常敏感,即使意思完全正确,只要表达方式不同,分数也会偏低。因此,人类的得分更应该被理解为"衡量任务难度的参照线",而不是"AI需要超越的上限"。

---

说到底,SEMANTICQA这套测试平台告诉我们一件重要的事:今天最强大的AI语言模型,在处理人类语言最精妙的部分时,仍然存在系统性的短板。它们可以在分类题上表现得比人类更稳定,却在"精确找到答案在哪"这件事上屡屡失手;它们能生成听起来有道理的解释,但那些解释是否真正建立在深层语义理解上,还是只是在模仿例题的格式,仍是一个开放的问题。更关键的是,当一项任务需要先完成A再完成B时,A的失误会以倍数效应拖累最终结果——这说明真正的语言理解,需要的不是在某一道题上超常发挥,而是在整个理解链条上保持一致的稳健。

这项研究目前只覆盖了英语,四类语义短语也不能穷尽人类语言的全部复杂性。研究团队本身也指出,未来应当将测试扩展到多语言场景,并纳入更多复杂的任务组合方式。对于普通人而言,这项研究的实际意义在于提醒我们:当你让AI帮你读一封措辞委婉的邮件、分析一段含有隐喻的评论,或者翻译一首充满文化典故的歌词时,它理解的可能和你期待的,还差着一段距离。

有兴趣深入了解这项研究细节的读者,可以通过arXiv编号2604.16593检索完整论文,评估代码和数据集也已完整开源,研究路径是可以被复现和验证的。

---

Q&A

Q1:SEMANTICQA测试平台和普通的语言模型测试有什么不同?

A:普通的语言模型测试大多关注数学推理、代码生成或逻辑题,SEMANTICQA专门针对语言里的"非字面表达",比如成语、固定搭配、复合名词等。它最特别的地方在于,对同一个短语设计了三种不同形式的考题——选择题、精确定位题和开放解释题,通过观察模型在三种题型上是否表现一致,来判断它到底是真的理解了语义,还是只是猜对了某种格式的答案。

Q2:GPT-5在惯用语理解上超过了人类,是不是说明AI已经比人类更懂语言了?

A:这个结论需要谨慎对待。GPT-5在选择题形式的惯用语检测上确实超过了三位语言学研究生的参照得分,但那三位研究生的得分受到题目模糊性和评分方式的影响,并不代表真正的人类上限。而且GPT-5在同样是惯用语的精确定位任务上,得分明显低于人类参照基准。真正的语言理解应该在所有题型上都保持稳定,而不是在某一类题上大幅领先而在另一类题上落后。

Q3:给AI模型附上词汇定义(Oracle Schema策略)为什么能显著提升效果?

A:这是因为动词性多词表达(比如"click on"这类短语动词)的边界在很多情况下是模糊的,模型在没有明确定义的情况下,往往不确定"我要找的是哪类东西"。一旦在指令里附上清晰的类型定义和特征说明,就相当于给模型配了一本专用工具书,让它在搜索时有了明确的目标。实验数据显示,这种方式在零样本情况下帮助DeepSeek-R1提升了12.5个百分点,效果甚至优于直接多给几个例题的方式。